Cum Funcționează Generarea AI: De la GAN la Autoregresie

O incursiune în tehnologia din spatele AI: cum modelele GAN, Autoregresive și Diffusion generează imagini, video și sunet.

Cum funcționează generarea cu IA: de la GAN-uri la autoregresie

Te-ai întrebat vreodată cum poate o IA să transforme un simplu prompt text într-un peisaj spectaculos, un video cinematic sau o melodie memorabilă? Nu e magie—e matematică, arhitectură și foarte multe date.

Bun venit la articolul nostru despre tehnologia din spatele generării cu IA. Îți vom explica „marii trei” algoritmi și cum se aplică la conținutul media pe care îl creezi zi de zi.

#1. Duelul rețelelor: GAN-uri (Generative Adversarial Networks)

La începutul erei moderne a IA (în jurul anului 2014), GAN-urile erau regii necontestați ai generării de imagini.

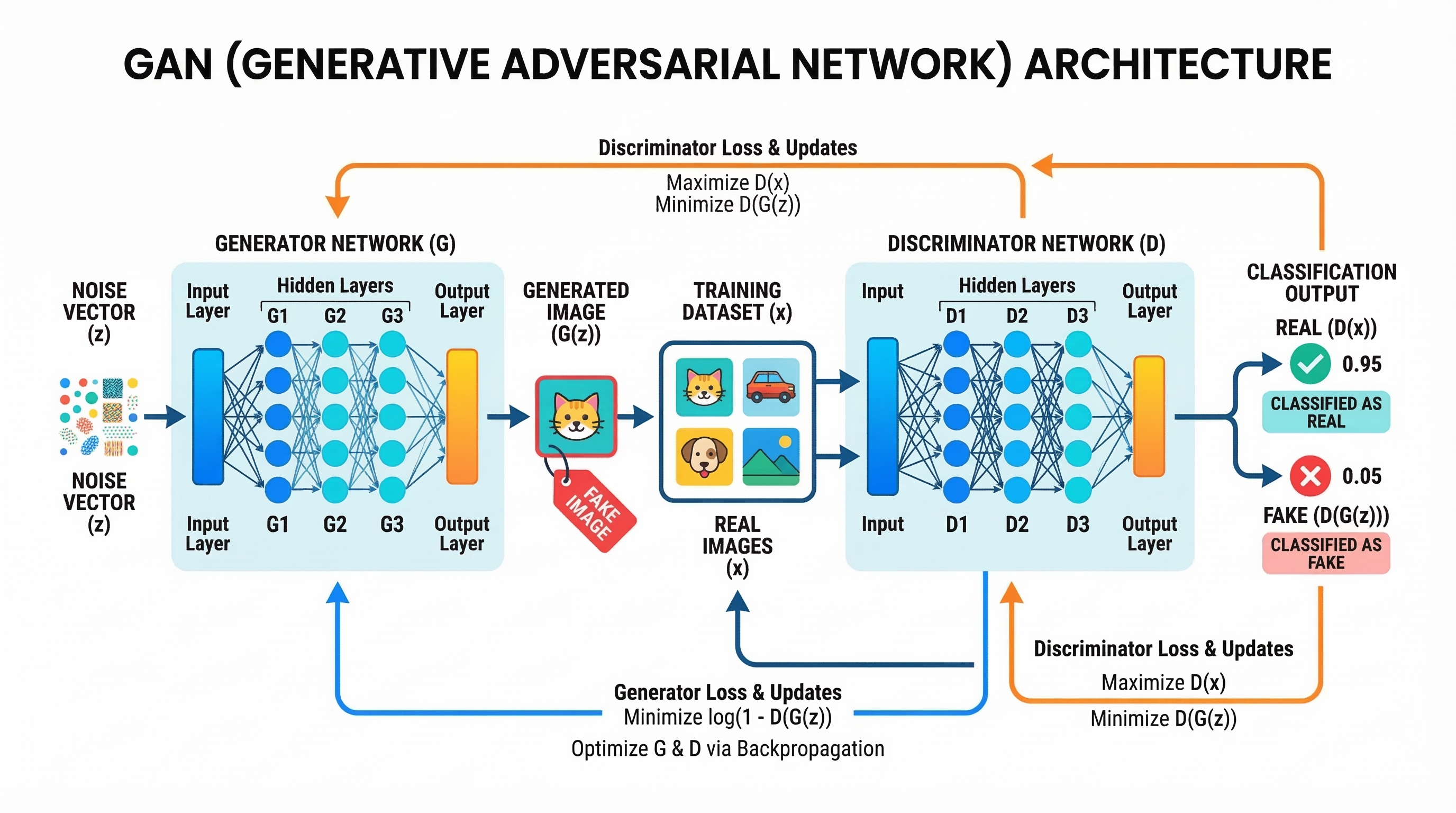

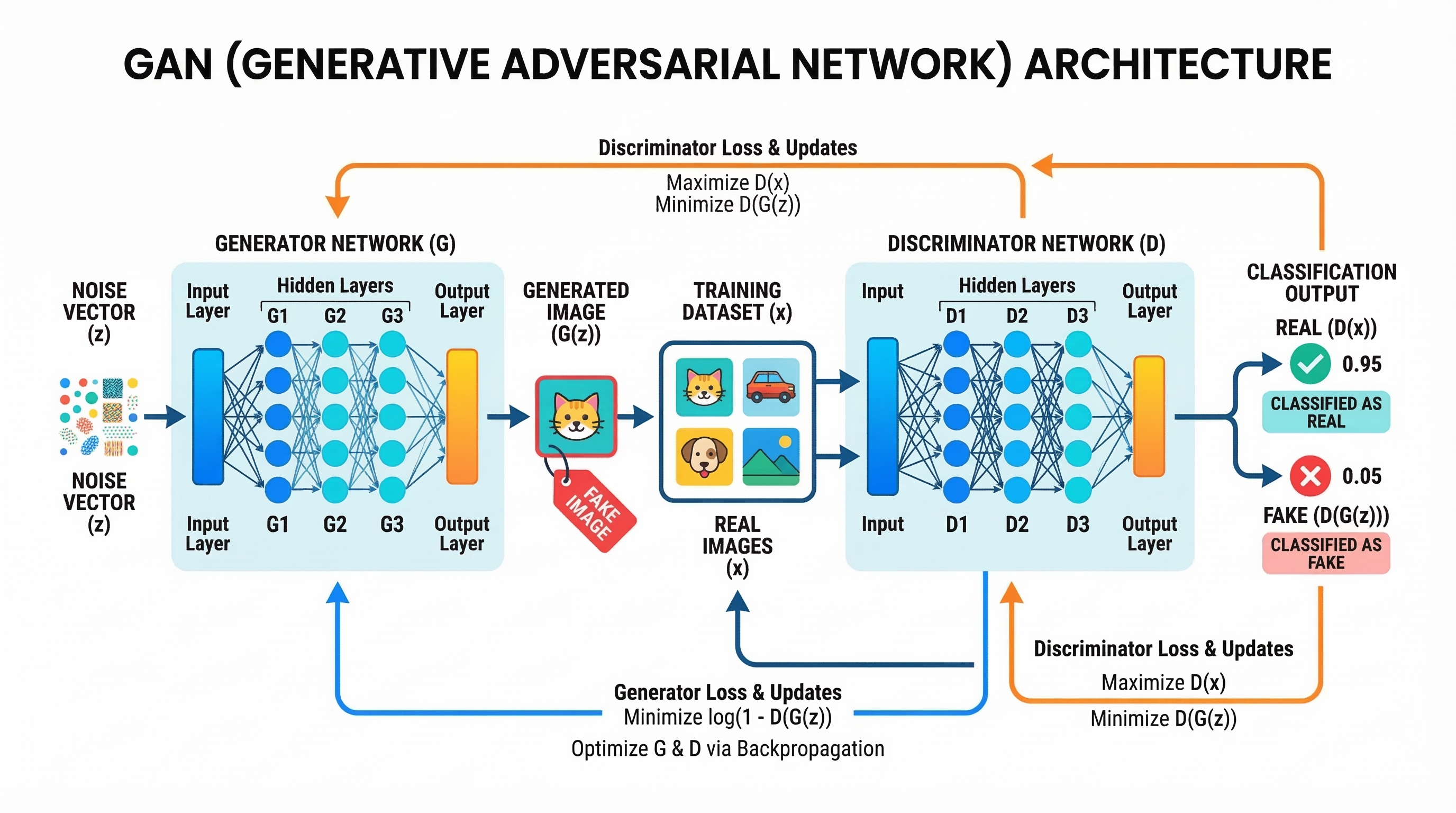

Gândește-te la un GAN ca la o competiție între două rețele:

- Generatorul: creează imagini false care par reale.

- Discriminatorul: trebuie să distingă între imagini reale (din setul de date) și cele generate.

Pe măsură ce concurează, ambele se îmbunătățesc. Generatorul învață să „păcălească” Discriminatorul, iar Discriminatorul învață să observe cele mai mici defecte. În final, Generatorul devine atât de bun încât Discriminatorul nu mai poate face diferența.

Ideal pentru: generare în timp real, traducere imagine-la-imagine și sarcini specifice precum upscaling.

#2. Pas cu pas: autoregresia

Autoregresia stă în spatele modelelor lingvistice mari (LLM) precum GPT, dar este folosită și în generarea media.

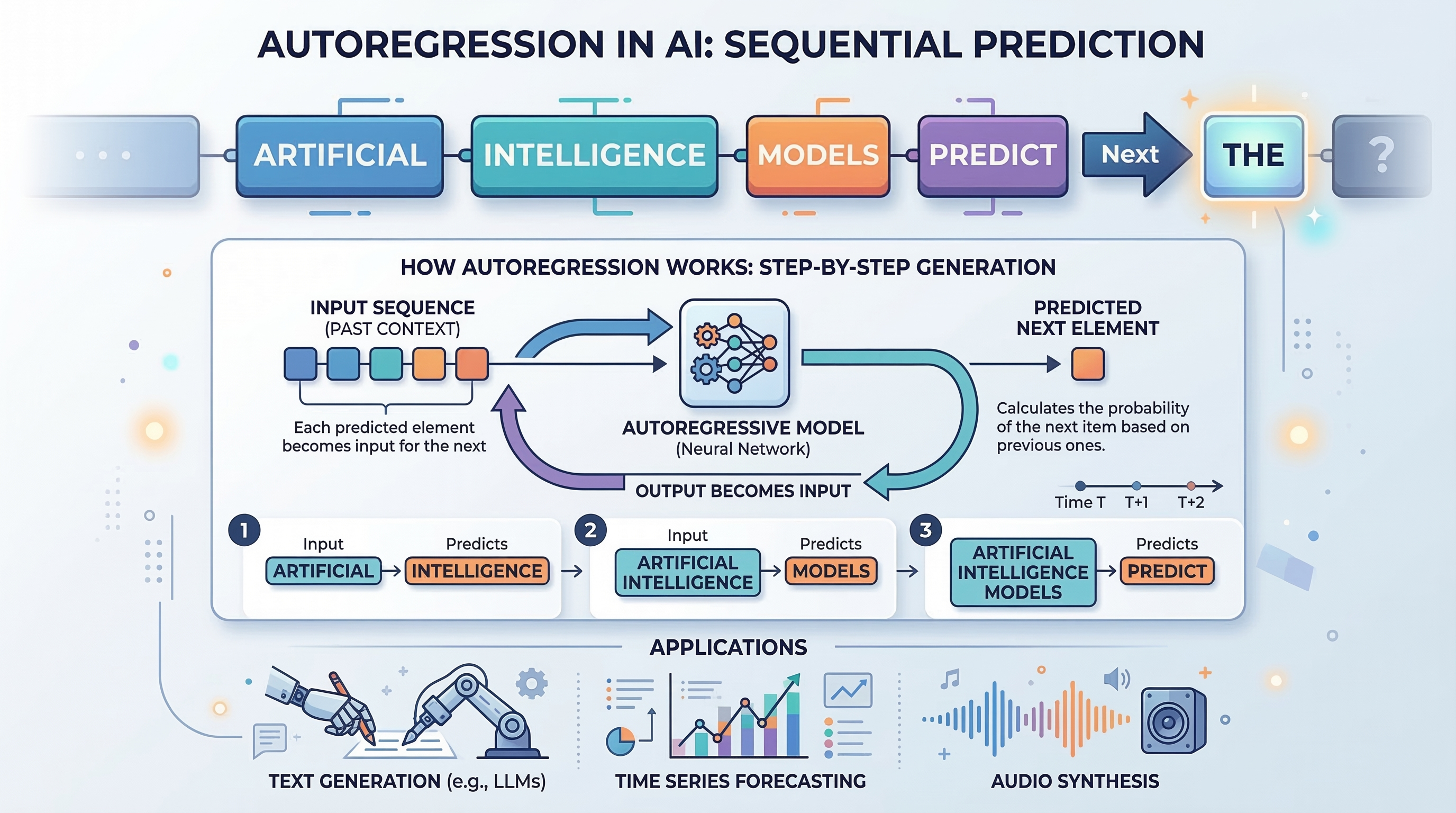

Ideea de bază este simplă: prezice următoarea bucată de date pe baza tuturor celor anterioare.

Dacă generezi o propoziție, IA prezice următorul cuvânt. Dacă generezi o imagine cu un model autoregresiv, poate prezice următorul pixel. Rezultatul se construiește bucată cu bucată, token cu token.

Ideal pentru: generare de text (LLM), sunet (tokeni audio) și consistență pe secvențe lungi.

#3. De la zgomot la capodoperă: modele de difuziune

Aceasta este tehnologia din spatele exploziei actuale de artă și video cu IA (precum Midjourney, Flux, Kling).

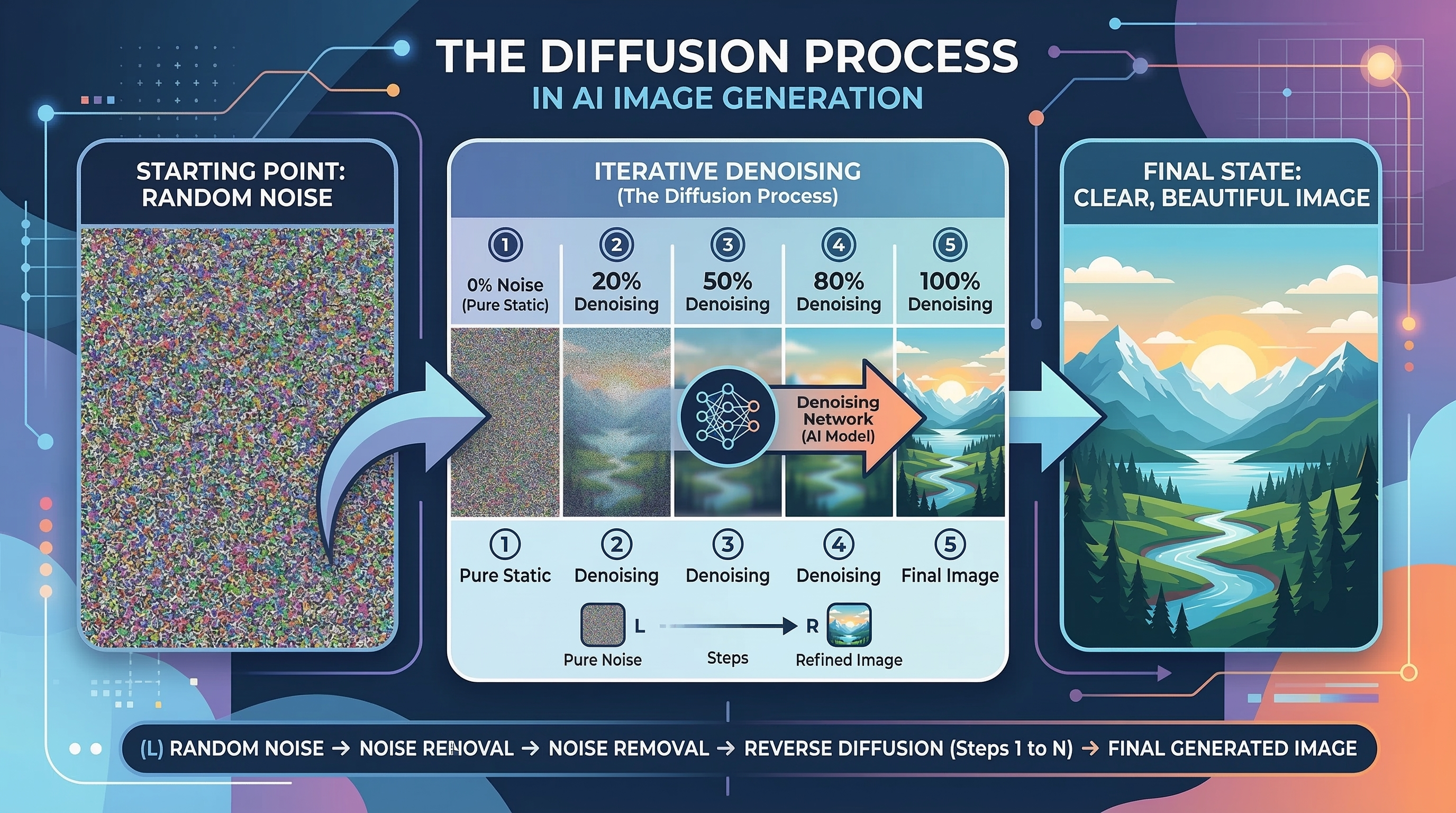

Modelele de difuziune pornesc de la „zgomot” pur—ca fâșâitul unei televiziuni vechi—și îl „denoisează” treptat până când apare o imagine clară.

În antrenament, IA învață să inverseze procesul de adăugare a zgomotului. Când îi dai un prompt, pornește de la un câmp aleatoriu de zgomot și „sculptează” pixelii în forma descrisă de prompt.

Ideal pentru: imagini de înaltă fidelitate, fotorealism și generare video complexă.

#4. Cum funcționează generarea de video

Generarea video este esențial „difuziune 3D” sau „autoregresie temporală”.

Modele precum Kling 3.0 sau Veo 3.1 nu generează cadre izolate—trebuie să asigure consistență temporală. Dacă o minge se mișcă în cadrul 1, poziția ei în cadrul 2 trebuie să fie logică.

IA folosește mecanisme de atenție care privesc mai multe cadre simultan, astfel încât fizica, lumina și mișcarea rămân coerente.

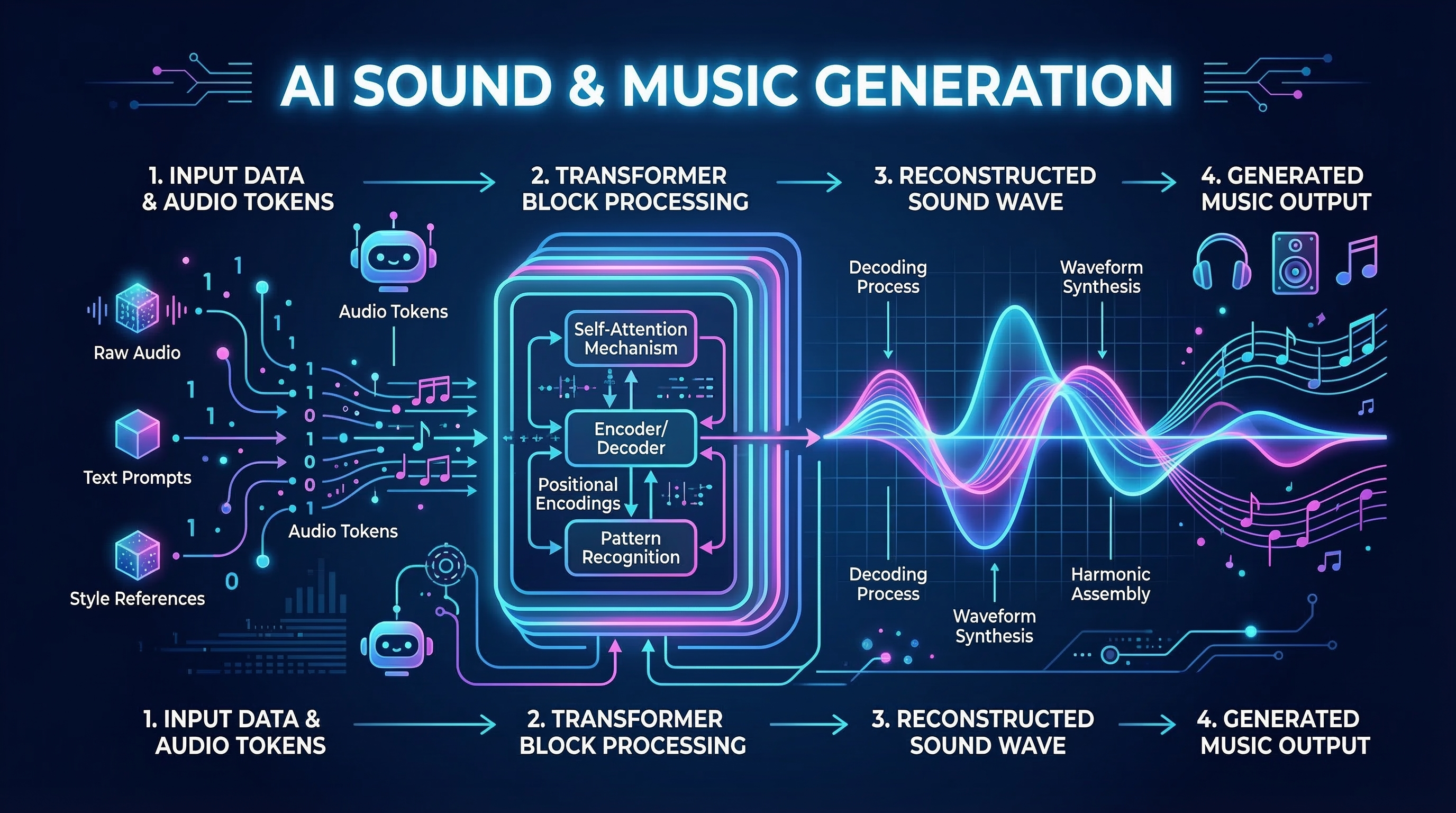

#5. Ritmul datelor: sunet și muzică

Generarea audio combină adesea autoregresia cu difuziunea.

Modele precum Suno (cântece complete) sau ElevenLabs (voce) transformă audio-ul în „tokeni” (similar cuvintelor). Prezic următorul token audio, apoi un vocoder (adesea difuziv) îi transformă în unde sonore de calitate.

#Concluzie: viitorul creativității

Înțelegerea „cum” din spatele rezultatului te ajută să creezi mai bine. Fie că e natura competitivă a GAN-urilor, logica pas-cu-pas a autoregresiei sau magia difuziunii, fiecare arhitectură aduce un stil propriu.

La Kubeez îți punem la dispoziție aceste modele într-o singură platformă. Începe acum.