Gemini Omni: ce știm despre noul model video al Google scurs înainte de I/O 2026

Modelul video Gemini Omni al Google a apărut într-un șir UI scurs înaintea Google I/O 2026 (19–20 mai). Iată ce este confirmat, ce este zvon, trei interpretări plauzibile și cum s-ar compara Omni cu Veo 3.1, Seedance 2, Kling 3.0 și cu Sora 2 aflată în închidere.

Gemini Omni: Ce știm despre noul model video al Google scurs înainte de I/O 2026

Cu opt zile înainte de Google I/O 2026, un șir de text din interfață a apărut în secțiunea de generare video a Gemini și a atras atenția întregii comunități AI: „Start with an idea or try a template. Powered by Omni."

Această singură linie — observată inițial de utilizatorul Thomas16937378 pe X și amplificată de TestingCatalog pe 2 mai 2026 — este cel mai puternic semnal de până acum că Google se pregătește să lanseze un nou model de generare video sub numele Gemini Omni, alături de (sau în locul) actualului pipeline „Toucan" alimentat de Veo 3.1 pe care Gemini îl folosește astăzi.

Acest articol separă ce a fost cu adevărat scurs de ce este zvon, parcurge cele trei interpretări plauzibile ale „Omni", îl compară cu restul peisajului AI video — Veo 3.1, Seedance 2, Kling 3.0 — și arată unde se încadrează Kubeez indiferent dacă Omni va fi sau nu lansat la I/O pe 19–20 mai.

#Ce a fost confirmat de fapt (și ce nu)

Să fim preciși despre dovezi, pentru că rezultatele de căutare pentru „Gemini Omni" se umplu deja de speculații prezentate ca fapte.

Confirmat de leak:

- Șirul de text literal „Start with an idea or try a template. Powered by Omni." apare în interiorul secțiunii de generare video a Gemini.

- Șirul stă lângă „Toucan", numele de cod intern al instrumentului video existent al Gemini — care în prezent este alimentat de Veo 3.1.

- Leak-ul a apărut pe 2 mai 2026, cu aproximativ două săptămâni înainte de Google I/O 2026 (19–20 mai), conferința unde Google a confirmat că actualizările Gemini și AI sunt pe ordinea de zi.

Neconfirmat încă de Google:

- Rezoluție, durată clip, frame rate.

- Dacă Omni generează audio nativ (așa cum face Veo 3.1).

- Dacă Omni este text-to-video, image-to-video sau ambele.

- Preț sau cost per secundă.

- Disponibilitate publică — aplicația Gemini consumer, Vertex AI sau ambele.

- Dacă „Omni" este un model nou, sau doar o nouă suprafață produs peste unul existent.

Dacă un articol pe care îl citești online citează specificații (8K, 60 FPS, clipuri de 60 de secunde, „alimentat de Gemini 3 Ultra" etc.), este speculație. Suprafața expusă de leak este un singur șir UI. Tratează totul în plus ca pe o presupunere până când Sundar Pichai urcă pe scenă pe 19 mai — inclusiv articolul Kubeez pe care îl citești acum.

#Trei interpretări plauzibile ale „Omni"

Acoperirea de la TestingCatalog, WaveSpeedAI și AIPlanetX converge spre trei posibilități. Niciuna nu se exclude reciproc.

#1. Omni este un nou nume public pentru pipeline-ul alimentat de Veo

Cea mai simplă interpretare: Google rebrandează pur și simplu suprafața video adresată consumatorilor. „Toucan" a fost mereu un cod intern. „Powered by Omni" ar putea fi Google șlefuind narațiunea consumer înainte de I/O, cu Veo 3.x făcând în continuare treaba pe dedesubt. Aceasta ar fi o mișcare de marketing, nu un model nou.

#2. Omni este un nou model video antrenat în familia Gemini, alături de Veo

Mai interesant: Omni este un model separat antrenat în interiorul familiei Gemini — analog modului în care Nano Banana 2 (Gemini 3.1 Flash Image) și Nano Banana Pro (Gemini 3) sunt modelele de imagine ale Google antrenate pe stack-ul Gemini, nu pe linia Imagen a DeepMind. În acest scenariu, Veo rămâne flagship-ul cinematic pentru lucru creativ de top, în timp ce Omni servește cazul de utilizare in-app, conversațional, „descrie un video și obține unul" la viteză și cost de consumator.

#3. Omni este un singur model multimodal care gestionează imagine și video împreună

Numele în sine — „Omni" — punctează aici. Oglindește tiparul de denumire pe care OpenAI l-a folosit cu GPT-4o („o" de la omni) pentru a semnala un singur model care gestionează nativ multiple modalități. Dacă acesta este planul, Omni ar genera video, imagine și audio dintr-un model unificat cu arhitectură Gemini, cu fereastra de context lungă cu care Gemini este deja cunoscut. Încarci un script de 50 de pagini, primești înapoi caractere și iluminare consistente de-a lungul unei întregi secvențe generate.

Aceasta este versiunea Omni care chiar ar zgudui piața — pentru că nimeni altcineva nu lansează astăzi video + imagine + audio multimodal unificat într-un singur model. Veo + Imagen + Lyria sunt în pipeline-uri separate la Google. Sora a fost doar video. Seedance și Kling sunt doar video. Chiar și generarea de imagini GPT-4o de la OpenAI trăiește într-o cale de execuție separată față de munca lor video.

Un omni-model adevărat ar schimba modul în care creatorii gândesc despre prompting — mai puțin „generează un clip, generează artă, editează-le împreună", mai mult „descrie scena cap-coadă".

#Cum s-ar încadra Omni în peisajul AI video

Pentru a înțelege de ce contează acest leak, ai nevoie de harta actuală a AI video la mai 2026.

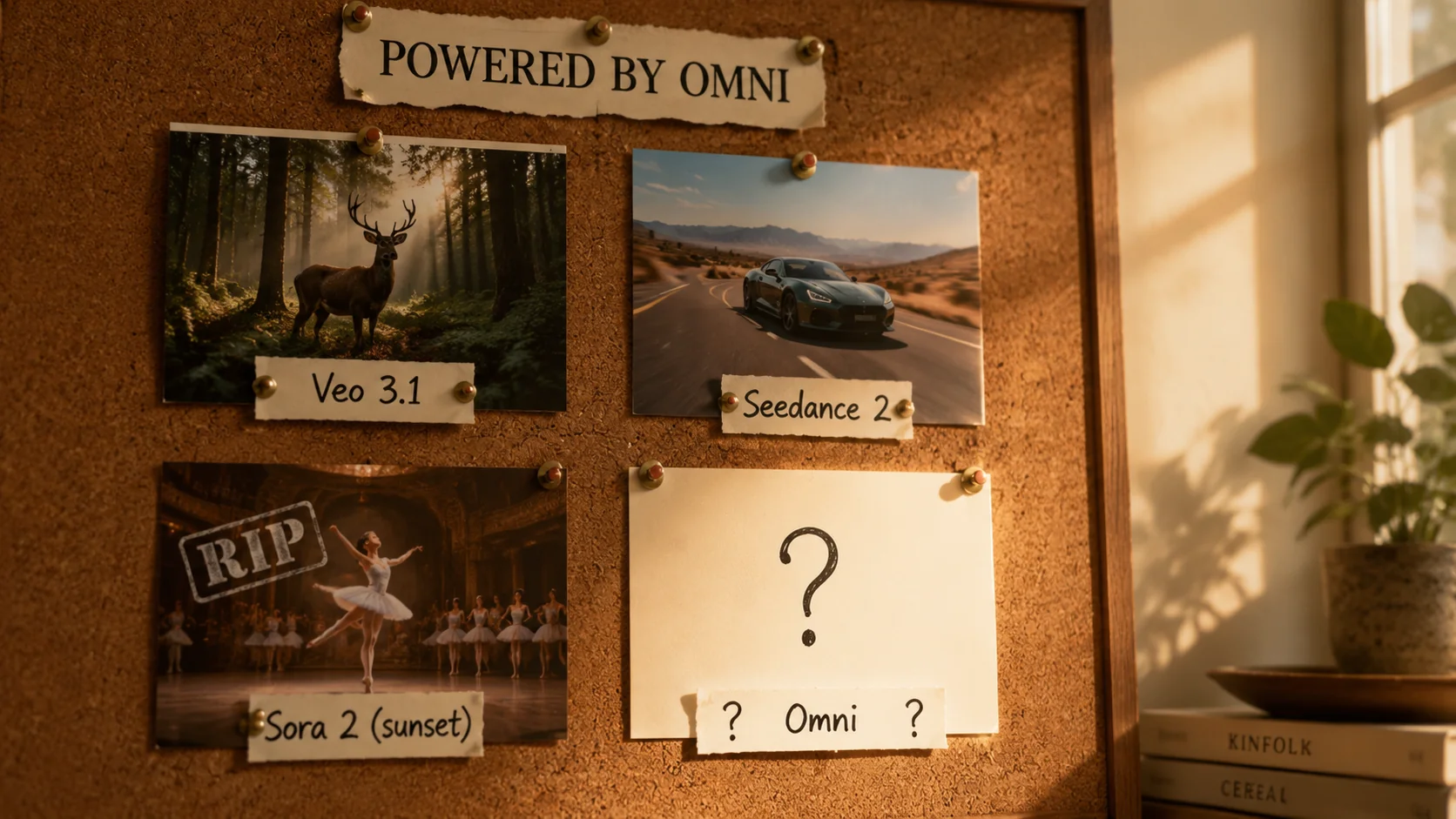

Veo 3.1 (Google) este reperul cinematic actual. Fizică puternică, audio nativ cu dialog, extensie de scenă, până la 3 imagini de referință pentru consistența personajelor, clipuri de 4–8 secunde la 720p sau 1080p cu upscaling 4K. Alimentează tab-ul „Toucan" al Gemini astăzi și este disponibil pe Kubeez — vezi analiza Veo 3.1.

Seedance 2 (ByteDance) este în prezent în topul mai multor benchmark-uri publice de video-gen pentru aderența la prompt și calitatea mișcării la o fracțiune din prețul flagship. Audio este pornit implicit. Disponibil pe Kubeez în două niveluri — Seedance 2 și Seedance 2 Fast.

Kling 3.0 (Kuaishou) este opțiunea premium pentru mișcare de top, pentru lucru creativ avansat. Gestionare mai puternică a mișcării decât majoritatea competitorilor, cu audio nativ în 2.6 și suport pentru forme mai lungi. Vezi Kling 3.0 vs 2.6.

Sora 2 (OpenAI) este, începând cu martie 2026, o poveste de închidere mai degrabă decât un competitor. Aplicația Sora pentru consumatori se închide, iar API-urile pentru dezvoltatori se închid și ele, conform rapoartelor. Slot-ul ocupat de Sora 2 — „generare video viral pentru consumator cu distribuție socială" — este acum complet liber. Poziționarea expusă de leak a Omni în interiorul Gemini (nu ca aplicație separată) se citește ca o mișcare deliberată în acest spațiu eliberat.

Dacă interpretarea #3 este corectă și Omni chiar este un omni-model unificat, propunerea competitivă a Google devine: „Un model, un prompt, o aplicație, o factură — pentru tot ceea ce altfel ai cusut din Veo, Imagen, ElevenLabs și un editor video." Aceasta este o amenințare mai mare pentru stack-urile fragmentate decât orice competitor cu o singură modalitate.

#Când și unde va fi probabil lansat Omni

Cel mai puternic semnal indică Google I/O 2026 pe 19–20 mai. Google a confirmat că actualizările Gemini și AI sunt pe agenda keynote-ului, leak-ul este suficient de recent încât Google clar nu intenționa să-l expună încă, iar „Powered by Omni" este genul de placeholder pe care l-ai lansa cu două săptămâni mai devreme din greșeală — nu cu două luni.

Cele mai probabile prime suprafețe:

- Aplicația Gemini consumer (web și mobile), ca tab în interiorul suprafeței existente de generare video.

- Vertex AI pentru dezvoltatori, posibil cu aceeași împărțire „Veo + Omni" pe care Google o face pentru „Imagen + Nano Banana" pe imagini.

- Un endpoint Gemini API, facturat pe secundă ca Veo.

Mai puțin probabil dar posibil:

- O nouă suprafață standalone „Gemini Studio for Video" — Google a arătat disponibilitate să lanseze aplicații creative pentru consumator (Whisk, NotebookLM) atunci când vor o poveste de produs focalizată.

Vom actualiza acest articol în ziua în care Google anunță, cu specificații verificate.

#Ce ar trebui să facă creatorii Kubeez săptămâna asta

Trei sfaturi sincere:

1. Nu pune pe pauză roadmap-ul așteptând Omni.

Dacă lansezi conținut săptămâna asta, lansează-l pe ce funcționează astăzi: Veo 3.1 pentru cinematic, Seedance 2 pentru iterație rapidă cu audio, Kling 3.0 pentru mișcare premium. Toate trei sunt pe generare video Kubeez chiar acum și produc același calibru de output indiferent de ce se anunță pe 19 mai.

2. Planifică să faci A/B Omni cu modelul tău actual în ziua în care apare.

Modul corect de a evalua orice nou model video este același brief în aceeași zi pe un stack pe care îl controlezi. Rulează brief-ul tău standard de testare — un demo de produs de 6 secunde, un cadru cinematic de 4 secunde cu dialog, un clip social vertical 9:16 — prin Omni și prin daily driver-ul tău actual. Lasă output-ul să decidă, nu keynote-ul de lansare.

3. Stai pe o platformă multi-model.

Aceasta este lecția pe care închiderea Sora 2 a întipărit-o pentru multe echipe: pariind un întreg flux de conținut pe roadmap-ul unui singur vendor este fragil. Echipele care au gestionat curat închiderea Sora 2 au fost cele care rulau deja pe platforme cu mai multe modele video — au migrat schimbând un dropdown, nu reconstruind pipeline-ul.

Kubeez rulează Veo 3.1, Seedance 2, Seedance 2 Fast, Kling 3.0, Kling 2.6, plus modele de imagine (Nano Banana 2, Nano Banana Pro, gpt-image-2, Flux, Z-Image), audio (muzică, dialog, clonare voce) și captions într-un singur workspace cu un singur pool de credite. Dacă Gemini Omni apare și suntem impresionați, se alătură catalogului. Dacă nu, n-ai pierdut nimic.

#Ce vom urmări la I/O pe 19 mai

Când Google urcă pe scenă pe 19 mai, iată lista scurtă de întrebări care contează cu adevărat pentru creatori și dezvoltatori:

- Este Omni un model nou sau un wrapper nou? Concret: vine cu un model card nou și un benchmark suite nou, sau este doar redenumirea unui tab?

- Este nativ multimodal? Același prompt produce video + audio + consistență de imagine de referință, sau încă apelează la pipeline-uri Imagen / Lyria separate pe dedesubt?

- Care este plafonul de durată și rezoluție? Veo 3.1 se oprește la 4–8 secunde și 1080p (cu upscale 4K). Sora demonstra 60 de secunde înainte de închidere. Plafonul Omni ne va spune mult despre cine vizează Google.

- Audio este în același pas cu video? Cea mai puternică funcție a Veo 3.1 este audio + video într-o singură trecere, cu sincronizare buză. Dacă Omni păstrează acest lucru și adaugă control pe muzică sau dialog, este un upgrade. Dacă le împarte, este un pas înapoi.

- Există un endpoint Vertex AI la lansare, sau doar consumer? Determină cât de repede poate ajunge pe platforme precum Kubeez.

- Cât costă pe secundă? Veo 3.1 are preț premium. Dacă Omni îl subcotează, pune presiune pe întreaga piață.

Vom actualiza acest articol în momentul în care aceste întrebări primesc răspuns.

#FAQ

Este Gemini Omni anunțat oficial? Nu. Începând cu 11 mai 2026, singura dovadă publică este un șir UI scurs („Powered by Omni") în secțiunea de generare video a Gemini, raportat prima dată pe 2 mai 2026. Google nu a confirmat modelul, capabilitățile, prețul sau data lansării. Cea mai probabilă fereastră de anunț este Google I/O 2026 pe 19–20 mai.

Este Gemini Omni disponibil pe Kubeez? Nu — pentru că nu este disponibil public nicăieri încă. Dacă Google lansează Omni la I/O 2026 cu un endpoint Vertex AI, îl vom evalua pentru catalogul video Kubeez la fel cum am evaluat Veo 3.1, Seedance 2 și Kling 3.0. Abonează-te la blogul Kubeez sau verifică ghidul modelelor AI pentru actualizări.

Cu ce diferă Omni de Veo 3.1? Nu știm încă. Teoriile principale (niciuna confirmată) sunt: (1) Omni este noul nume public pentru același pipeline alimentat de Veo; (2) Omni este un model video Gemini separat care rulează alături de Veo; sau (3) Omni este un model multimodal unificat care gestionează imagine, video și audio într-un singur pas de generare — analog modului în care GPT-4o gestionează text, imagine și audio împreună.

Ar trebui să trec de la Veo 3.1 sau Seedance 2 pentru a aștepta Omni? Nu. Veo 3.1, Seedance 2 și Kling 3.0 sunt lansate astăzi și produc output de calitate profesională. Nu pune pe pauză un roadmap de conținut pe baza unui șir UI scurs. Când Omni se lansează, fă A/B cu stack-ul tău actual pe același brief — lasă output-ul să decidă, nu keynote-ul.

Va înlocui Gemini Omni Sora 2? Aplicația Sora 2 pentru consumatori se închide deja (anunțat în martie 2026 — vezi acoperirea noastră). Slot-ul „video AI viral pentru consumator" ocupat de Sora 2 este liber. Suprafața expusă de leak a Omni este în interiorul aplicației Gemini consumer, ceea ce este consistent cu Google mutându-se în acest spațiu eliberat — dar dacă o face cu succes depinde de modelul în sine, lucru pe care îl vom afla pe 19 mai.

#Concluzie

Gemini Omni este suficient de real pentru a planifica în jurul lui, dar nu încă suficient de real pentru a paria pe el. Leak-ul este credibil — un șir UI a apărut pe o suprafață Gemini live, cu două săptămâni înainte de un keynote Google cunoscut — dar specificațiile sunt încă vapor. Mișcarea inteligentă săptămâna asta este să continui să livrezi pe Veo 3.1, Seedance 2 și Kling 3.0, și să fii gata să testezi Omni cu ele în ziua în care se lansează.

Când vine acea zi, generarea video Kubeez va avea ce câștigă pe meritele sale — alături de restul catalogului de modele pe care îl folosești deja.

Pentru peisajul mai larg al modelelor pe care să le folosești pentru fiecare job, vezi ghidul modelelor AI și primer-ul de workflow text-to-video. Pentru modelul care va fi cel mai direct comparat cu Omni la lansare, citește analiza Veo 3.1.

Vezi și