Gemini Omni: lo que sabemos del nuevo modelo de video de Google filtrado antes de I/O 2026

El modelo de video Gemini Omni de Google apareció en una cadena UI filtrada antes de Google I/O 2026 (19–20 de mayo). Esto es lo confirmado, lo rumoreado, tres interpretaciones plausibles y cómo se compararía Omni con Veo 3.1, Seedance 2, Kling 3.0 y la app Sora 2 en cierre.

Gemini Omni: Lo que Sabemos del Nuevo Modelo de Video de Google Filtrado Antes de I/O 2026

Ocho días antes de Google I/O 2026, una cadena de texto de la interfaz apareció dentro de la pestaña de generación de video de Gemini y tiene a la comunidad de IA prestando muchísima atención: "Start with an idea or try a template. Powered by Omni."

Esa única línea — vista por primera vez por el usuario Thomas16937378 en X y amplificada por TestingCatalog el 2 de mayo de 2026 — es la señal más fuerte hasta ahora de que Google se prepara para lanzar un nuevo modelo de generación de video bajo el nombre Gemini Omni, junto a (o en lugar de) la actual canalización "Toucan" alimentada por Veo 3.1 que Gemini usa hoy.

Este artículo separa lo que se ha filtrado de hecho de lo que es rumor, recorre las tres interpretaciones plausibles de "Omni", lo compara con el resto del campo del video con IA — Veo 3.1, Seedance 2, Kling 3.0 — y muestra dónde encaja Kubeez tanto si Omni se lanza en I/O el 19–20 de mayo como si no.

#Lo que está realmente confirmado (y lo que no)

Seamos precisos sobre la evidencia, porque los resultados de búsqueda para "Gemini Omni" ya se están llenando de especulación vestida de hecho.

Confirmado por la filtración:

- La cadena literal "Start with an idea or try a template. Powered by Omni." aparece dentro de la pestaña de generación de video de Gemini.

- La cadena se ubica junto a "Toucan", el nombre clave interno de la herramienta de video existente de Gemini — que actualmente está alimentada por Veo 3.1.

- La filtración apareció el 2 de mayo de 2026, aproximadamente dos semanas antes de Google I/O 2026 (19–20 de mayo), la conferencia donde Google ha confirmado que las actualizaciones de Gemini y de IA están en la agenda.

Aún no confirmado por Google:

- Resolución, longitud de clip, frame rate.

- Si Omni genera audio de forma nativa (como lo hace Veo 3.1).

- Si Omni es text-to-video, image-to-video, o ambos.

- Precios o coste por segundo.

- Disponibilidad pública — app de consumo de Gemini, Vertex AI, o ambas.

- Si "Omni" es un modelo nuevo en absoluto, frente a una nueva superficie de producto sobre uno existente.

Si un artículo que lees online cita especificaciones (8K, 60 FPS, clips de 60 segundos, "alimentado por Gemini 3 Ultra", etc.), es especulación. La superficie filtrada es una sola cadena de UI. Trata todo lo demás como una conjetura hasta que Sundar Pichai suba al escenario el 19 de mayo — incluido el artículo de Kubeez que estás leyendo ahora mismo.

#Tres interpretaciones plausibles de "Omni"

La cobertura de TestingCatalog, WaveSpeedAI y AIPlanetX converge en tres posibilidades. Ninguna es mutuamente excluyente.

#1. Omni es un nuevo nombre público para la canalización alimentada por Veo

Interpretación más sencilla: Google simplemente está cambiando la marca de la superficie de video orientada al consumidor. "Toucan" siempre fue un nombre clave interno. "Powered by Omni" podría ser Google puliendo la narrativa de consumidor antes de I/O, con Veo 3.x todavía haciendo el trabajo por debajo. Esto sería un movimiento de marketing, no un modelo nuevo.

#2. Omni es un nuevo modelo de video entrenado en Gemini junto a Veo

Más interesante: Omni es un modelo separado entrenado dentro de la familia Gemini — análogo a cómo Nano Banana 2 (Gemini 3.1 Flash Image) y Nano Banana Pro (Gemini 3) son los modelos de imagen de Google entrenados en el stack de Gemini en lugar del linaje Imagen de DeepMind. En este escenario, Veo se mantiene como el flagship cinematográfico para trabajo creativo de gama alta, mientras que Omni sirve el caso de uso in-app, conversacional, "describe un video y obtén uno" a velocidad y coste de consumidor.

#3. Omni es un único modelo multimodal que maneja imagen y video juntos

El nombre en sí — "Omni" — apunta aquí. Refleja el patrón de nomenclatura que OpenAI usó con GPT-4o ("o" de omni) para señalar un único modelo que maneja nativamente múltiples modalidades. Si esta es la jugada, Omni generaría video, imagen y audio desde un modelo unificado de arquitectura Gemini, con la larga ventana de contexto por la que ya se conoce a Gemini. Subes un guion de 50 páginas, recibes de vuelta personajes y luz consistentes a lo largo de toda una secuencia generada.

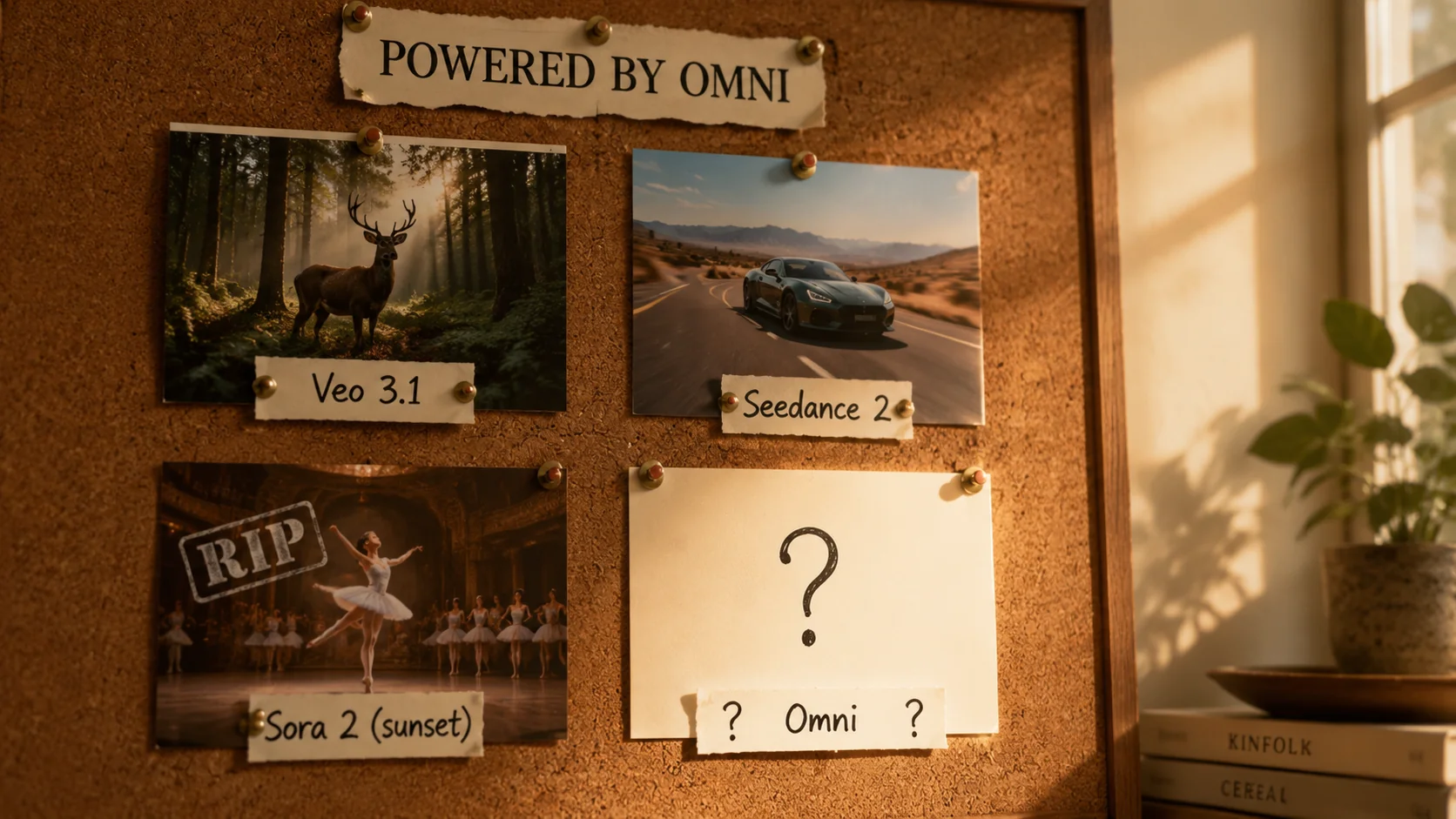

Esta es la versión de Omni que realmente sacudiría el mercado — porque nadie más lanza hoy video + imagen + audio multimodal unificado en un solo modelo. Veo + Imagen + Lyria están en canalizaciones separadas en Google. Sora era solo video. Seedance y Kling son solo video. Incluso la generación de imagen de GPT-4o de OpenAI vive en una ruta de ejecución separada del trabajo de video.

Un omni-modelo verdadero cambiaría cómo los creadores piensan sobre el prompting — menos "genera un clip, genera arte, edítalos juntos", más "describe la escena de principio a fin".

#Cómo encajaría Omni en el panorama del video con IA

Para entender por qué importa esta filtración, necesitas el mapa actual del video con IA a mayo de 2026.

Veo 3.1 (Google) es el referente cinematográfico actual. Física fuerte, audio nativo con diálogo, extensión de escena, hasta 3 imágenes de referencia para consistencia de personaje, clips de 4–8 segundos en 720p o 1080p con upscaling 4K. Alimenta la pestaña "Toucan" de Gemini hoy y está disponible en Kubeez — ver nuestro análisis profundo de Veo 3.1.

Seedance 2 (ByteDance) actualmente encabeza varios benchmarks públicos de video-gen por adherencia al prompt y calidad de movimiento a una fracción del precio flagship. El audio está activo por defecto. Disponible en Kubeez en dos niveles — Seedance 2 y Seedance 2 Fast.

Kling 3.0 (Kuaishou) es la opción premium para movimiento de gama alta y trabajo creativo de élite. Mejor manejo de movimiento que la mayoría de competidores, con audio nativo en 2.6 y soporte de formato más largo. Ver Kling 3.0 vs 2.6.

Sora 2 (OpenAI) es, desde marzo de 2026, una historia de cierre más que un competidor. La app de consumo Sora se está cerrando y, según informes, las APIs para desarrolladores también. El espacio que ocupaba Sora 2 — "generación de video viral de consumo con distribución social" — está ahora completamente abierto. El posicionamiento filtrado de Omni dentro de Gemini (no como una app separada) se lee como una jugada deliberada hacia ese espacio liberado.

Si la interpretación #3 es correcta y Omni realmente es un omni-modelo unificado, la propuesta competitiva de Google se convierte en: "Un modelo, un prompt, una app, una factura — para todo lo que de otro modo coserías a partir de Veo, Imagen, ElevenLabs y un editor de video." Esa es una amenaza más grande para los stacks fragmentados que cualquier competidor de modalidad única.

#Cuándo y dónde se lanzará probablemente Omni

La señal más fuerte apunta a Google I/O 2026 el 19–20 de mayo. Google ha confirmado que las actualizaciones de Gemini y de IA están en la agenda del keynote, la filtración es lo bastante reciente como para que Google claramente no pretendiera mostrarla aún, y "Powered by Omni" es el tipo de placeholder que se publicaría dos semanas antes por accidente — no dos meses.

Las primeras superficies más probables:

- La app de consumo de Gemini (web y móvil), como una pestaña dentro de la superficie de generación de video existente.

- Vertex AI para desarrolladores, posiblemente con la misma división "Veo + Omni" que Google hace para "Imagen + Nano Banana" en imágenes.

- Un endpoint de API de Gemini, facturado por segundo como Veo.

Menos probable pero posible:

- Una nueva superficie standalone "Gemini Studio for Video" — Google ha mostrado disposición a lanzar apps creativas de consumo (Whisk, NotebookLM) cuando quieren una historia de producto enfocada.

Actualizaremos este artículo el día que Google anuncie, con especificaciones verificadas.

#Qué deberían hacer realmente esta semana los creadores de Kubeez

Tres consejos honestos:

1. No pauses tu roadmap esperando a Omni.

Si vas a publicar contenido esta semana, publícalo sobre lo que funciona hoy: Veo 3.1 para cinematográfico, Seedance 2 para iteración rápida con audio, Kling 3.0 para movimiento premium. Los tres están en generación de video de Kubeez ahora mismo y producen el mismo calibre de salida independientemente de lo que se anuncie el 19 de mayo.

2. Planifica hacer A/B de Omni contra tu modelo actual el día que se lance.

La forma correcta de evaluar cualquier nuevo modelo de video es el mismo brief el mismo día sobre un stack que tú controlas. Pasa tu brief de prueba estándar — un demo de producto de 6 segundos, un plano cinematográfico de 4 segundos con diálogo, un clip social vertical 9:16 — por Omni y por tu daily driver actual. Deja que la salida decida, no el keynote de lanzamiento.

3. Mantente en una plataforma multi-modelo.

Esa es la lección que el cierre de Sora 2 dejó marcada en muchos equipos: apostar todo un flujo de contenido a la hoja de ruta de un único proveedor es frágil. Los equipos que digirieron limpiamente el cierre de Sora 2 fueron los que ya estaban en plataformas con múltiples modelos de video — migraron cambiando un dropdown, no reconstruyendo su pipeline.

Kubeez ejecuta Veo 3.1, Seedance 2, Seedance 2 Fast, Kling 3.0, Kling 2.6, además de modelos de imagen (Nano Banana 2, Nano Banana Pro, gpt-image-2, Flux, Z-Image), audio (música, diálogo, clonación de voz) y subtítulos en un solo workspace con un solo pool de créditos. Si Gemini Omni se lanza y nos impresiona, se une al catálogo. Si no, no has perdido nada.

#Lo que estaremos vigilando en I/O el 19 de mayo

Cuando Google suba al escenario el 19 de mayo, esta es la lista corta de preguntas que realmente importan a creadores y desarrolladores:

- ¿Es Omni un modelo nuevo o un envoltorio nuevo? Específicamente: ¿llega con una nueva model card y una nueva suite de benchmarks, o es solo un cambio de nombre de pestaña?

- ¿Es nativamente multimodal? ¿El mismo prompt produce video + audio + consistencia de imagen de referencia, o todavía llama a canalizaciones Imagen / Lyria separadas por debajo?

- ¿Cuál es el techo de longitud de clip y resolución? Veo 3.1 tope a 4–8 segundos y 1080p (con upscale 4K). Sora estaba mostrando 60 segundos antes de su cierre. El techo de Omni nos dirá mucho sobre a quién apunta Google.

- ¿El audio está en la misma pasada que el video? La función más fuerte de Veo 3.1 es audio + video en una sola pasada con sincronización labial. Si Omni mantiene eso y añade control de música o diálogo, es una mejora. Si los separa, es un paso atrás.

- ¿Hay un endpoint de Vertex AI en el lanzamiento, o solo consumo? Determina lo rápido que puede aterrizar en plataformas como Kubeez.

- ¿Cuánto cuesta por segundo? Veo 3.1 tiene precio premium. Si Omni lo recorta, presiona a todo el mercado.

Actualizaremos este artículo en el momento en que estas preguntas obtengan respuesta.

#FAQ

¿Está Gemini Omni anunciado oficialmente? No. A 11 de mayo de 2026, la única evidencia pública es una cadena UI filtrada ("Powered by Omni") dentro de la pestaña de generación de video de Gemini, reportada por primera vez el 2 de mayo de 2026. Google no ha confirmado el modelo, sus capacidades, precios ni fecha de lanzamiento. La ventana de anuncio más probable es Google I/O 2026 el 19–20 de mayo.

¿Está Gemini Omni disponible en Kubeez? No — porque aún no está disponible públicamente en ningún sitio. Si Google lanza Omni en I/O 2026 con un endpoint de Vertex AI, lo evaluaremos para el catálogo de video de Kubeez de la misma forma que evaluamos Veo 3.1, Seedance 2 y Kling 3.0. Suscríbete al blog de Kubeez o consulta la guía de modelos de IA para actualizaciones.

¿En qué se diferencia Omni de Veo 3.1? Aún no lo sabemos. Las teorías principales (ninguna confirmada) son: (1) Omni es el nuevo nombre público para la misma canalización alimentada por Veo; (2) Omni es un modelo de video entrenado en Gemini separado que corre junto a Veo; o (3) Omni es un modelo multimodal unificado que maneja imagen, video y audio en una única pasada de generación — análogo a cómo GPT-4o maneja texto, imagen y audio juntos.

¿Debería cambiar de Veo 3.1 o Seedance 2 para esperar a Omni? No. Veo 3.1, Seedance 2 y Kling 3.0 se están enviando hoy y producen salida de calidad profesional. No pauses una hoja de ruta de contenido por una cadena UI filtrada. Cuando Omni se lance, hazle A/B contra tu stack actual sobre el mismo brief — deja que la salida decida, no el keynote.

¿Reemplazará Gemini Omni a Sora 2? La app de consumo Sora 2 ya se está cerrando (anunciado en marzo de 2026 — ver nuestra cobertura). El espacio "video viral de consumo con IA" que ocupaba Sora 2 está abierto. La superficie filtrada de Omni está dentro de la app de consumo de Gemini, lo cual es consistente con que Google se mueva hacia ese espacio liberado — pero si lo hace con éxito depende del modelo en sí, lo cual sabremos el 19 de mayo.

#Conclusión

Gemini Omni es lo bastante real como para planificar a su alrededor, pero aún no lo bastante real como para apostar por él. La filtración es creíble — una cadena UI apareció en una superficie de Gemini en vivo, dos semanas antes de un keynote conocido de Google — pero las especificaciones todavía son humo. La jugada inteligente esta semana es seguir publicando con Veo 3.1, Seedance 2 y Kling 3.0, y estar listos para probar Omni contra ellos el día que se lance.

Cuando llegue ese día, generación de video de Kubeez tendrá lo que gane por sus propios méritos — junto al resto del catálogo de modelos que ya usas.

Para el panorama más amplio de qué modelos usar para qué trabajo, ver la guía de modelos de IA y el primer de flujo de trabajo text-to-video. Para el modelo que será comparado más directamente con Omni en el lanzamiento, lee el análisis profundo de Veo 3.1.

Ver también